Für deutsche Unternehmen stellt der Einsatz Künstlicher Intelligenz eine bedeutende strategische Dichotomie dar. Einerseits dient KI als kraftvoller Motor für Innovation und Effizienz; andererseits bringt sie neuartige und komplexe Herausforderungen für die Unternehmensaufsicht mit sich. Ein robustes Risiko-, Compliance- und Governance-Rahmenwerk ist keine bürokratische Beschränkung, sondern ein strategischer Ermöglicher. Es bietet die notwendige Struktur, um KI-getriebene Wachstumsfelder mit Zuversicht zu verfolgen und gleichzeitig deren inhärente Risiken systematisch zu mindern.

Die strategische Notwendigkeit von KI-Governance

Für Führungskräfte auf C‑Level hat sich die Diskussion um KI vom bloßen Potenzial hin zu direkten Auswirkungen auf Gewinn- und Verlustverantwortung verschoben. Die operative Frage ist nicht mehr, ob KI integriert wird, sondern wie sie sicher, skalierbar und profitabel implementiert werden kann. Genau hier wird ein integrierter Ansatz für Governance, Risk und Compliance (GRC) mission-kritisch.

Ein effektives GRC-Rahmenwerk sollte als strategisches Chassis verstanden werden, auf dem alle KI-Initiativen aufgebaut werden. Es stellt sicher, dass ambitionierte Konzepte über isolierte Proof-of-Concepts hinaus zu leistungsfähigen, verlässlichen und unternehmensweiten Lösungen heranwachsen. Ohne diese Basisstruktur setzen sich Organisationen erheblichen betrieblichen, finanziellen und reputationsbezogenen Risiken aus.

Innovation entschärfen für wettbewerbliche Agilität

Auf dem deutschen Markt, wo Präzision, Qualität und Zuverlässigkeit oberste Priorität haben, ist das Silicon‑Valley‑Motto „move fast and break things" untragbar. Führungskräfte müssen stattdessen den Fokus auf methodische Entschärfung legen, um einen nachhaltigen Wettbewerbsvorteil aufzubauen. Ein proaktives KI‑Governance‑Modell schafft die notwendigen Leitplanken für schnelles, aber verantwortungsbewusstes Innovieren.

Bereit für Ihr AI-Projekt?

Lassen Sie uns besprechen, wie wir Ihnen helfen können, Ihr AI-Projekt in Wochen statt Monaten zu realisieren.

Ein proaktiver, eingebetteter Ansatz für KI‑Governance ist entscheidend, um ambitionierte KI‑Konzepte in sichere, skalierbare und profitable unternehmensweite Lösungen zu verwandeln. Damit verschiebt sich der Fokus von reiner Compliance hin zur Schaffung dauerhaften Geschäftswerts und strategischer Vorteile.

Dieser Ansatz verlangt, dass Aufsicht direkt in den KI‑Entwicklungszyklus eingebaut wird, anstatt sie als nachträgliche Compliance‑Prüfung zu behandeln. Diese tiefe Integration ist der Kern effektiver Risiko-, Compliance- und Governance-Strukturen. Sie stellt sicher, dass jedes KI‑System von Anfang an mit den strategischen Zielen übereinstimmt und strengen regulatorischen sowie ethischen Standards genügt. Die Prinzipien der Systemtechnik in der IT bieten weitere Einsichten, wie moderne Infrastruktur diese fortschrittlichen, integrierten Systeme stützen kann.

Schlüsselpfeiler einer modernen KI‑Governance‑Strategie

Um Strategie in Ausführung zu überführen, müssen Führungskräfte die Kernkomponenten etablieren, die das Fundament jedes erfolgreichen KI‑Governance‑Programms bilden:

- Klare Verantwortlichkeiten: Definieren Sie explizite Eigentümerschaften für KI‑Modelle, deren zugrunde liegende Daten und deren operative Ergebnisse. Das fördert transparente und stringente Entscheidungsprozesse.

- Systematische Risikoanalyse: Identifizieren und quantifizieren Sie potenzielle Risiken — von algorithmischer Verzerrung bis zu Datenschutzverletzungen — proaktiv, bevor sie zu Vorfällen werden.

- Regulatorische Compliance: Stellen Sie sicher, dass jede KI‑Anwendung bestehenden und sich abzeichnenden Regelwerken entspricht, wie dem EU‑KI‑Gesetz und der DSGVO, sowie branchenspezifischen Vorgaben.

- Transparente Abläufe: Führen Sie prüfbare Aufzeichnungen über das Verhalten von KI‑Modellen und Entscheidungsprozesse. Dies ist entscheidend, um Vertrauen bei internen Stakeholdern und externen Aufsichtsbehörden aufzubauen.

Indem diese Elemente priorisiert werden, können deutsche Unternehmen das volle Potenzial von KI ausschöpfen und regulatorische Komplexität in einen greifbaren Wettbewerbsvorteil verwandeln.

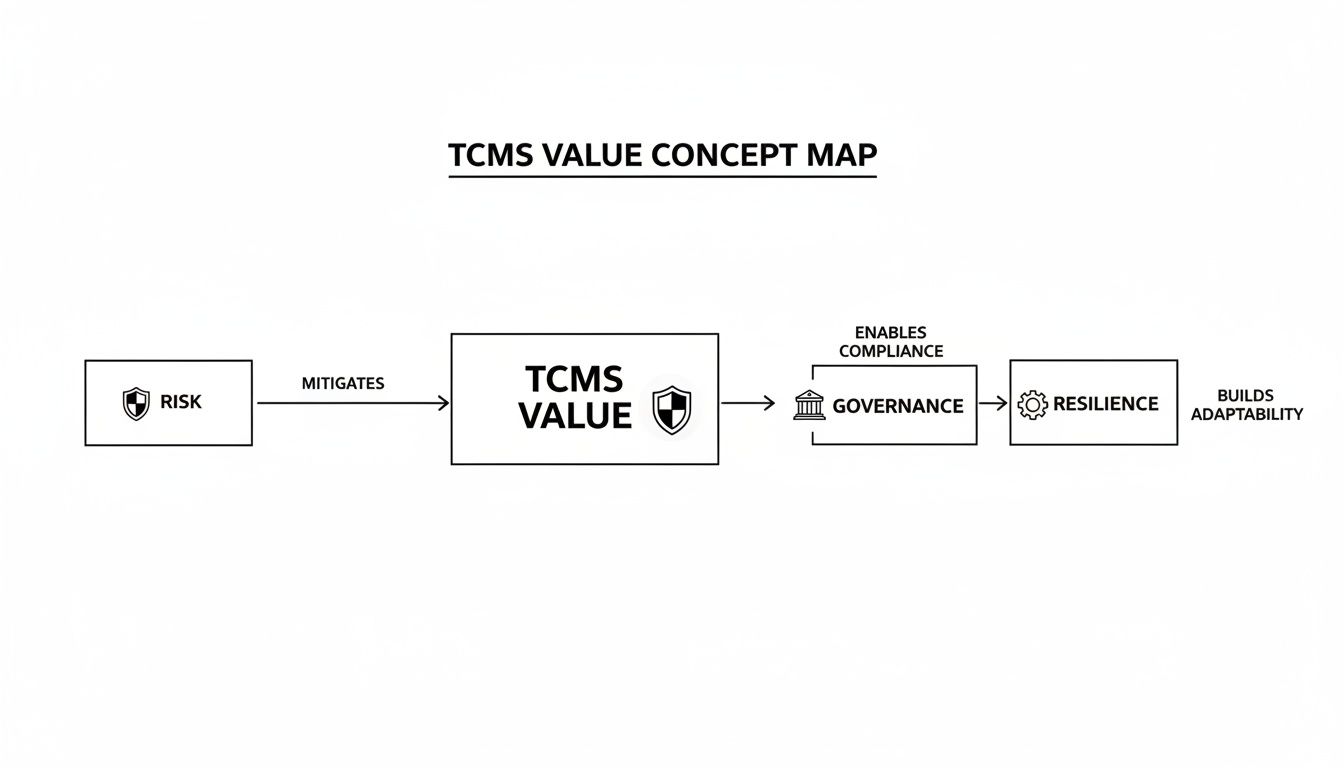

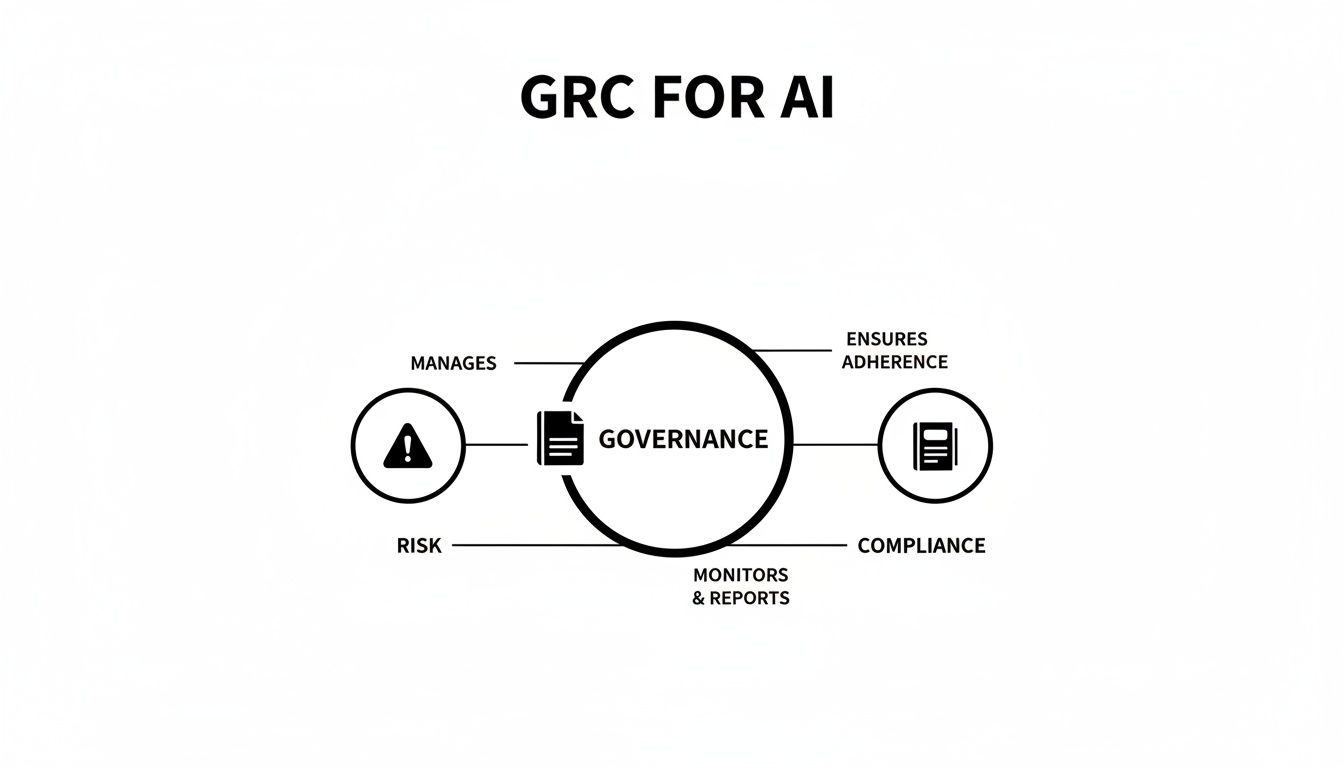

Das GRC‑Rahmenwerk für KI dekonstruieren

Um KI‑Initiativen erfolgreich umzusetzen, müssen Führungskräfte aufhören, Governance, Risk und Compliance (GRC) als voneinander getrennte Funktionen oder bloße Checklisten zu betrachten. Der einzige gangbare Weg besteht darin, sie als ein integriertes System zu behandeln. Dieser einheitliche Ansatz für Risiko, Compliance und Governance ist es, der ein vielversprechendes KI‑Experiment in ein zuverlässiges, unternehmensreifes Asset verwandelt.

Innovation beschleunigen?

Unser Expertenteam hilft Ihnen, Ideen in produktionsreife Lösungen zu verwandeln.

Betrachten Sie den Bau eines Hochleistungsmotors. Es reicht nicht, mächtige Komponenten zu besitzen; sie müssen perfekt zusammenarbeiten. Jedes Element des GRC‑Rahmenwerks spielt eine kritische, nicht verhandelbare Rolle, um sicherzustellen, dass das Gesamtsystem nicht nur leistungsfähig, sondern auch sicher und konform ist.

Governance: Das strategische Playbook

Governance bildet den strategischen Rahmen für alle KI‑bezogenen Aktivitäten. Sie legt die Organisationsstruktur fest, definiert Rollen, Verantwortlichkeiten und Entscheidungsbefugnisse für die Entwicklung, den Einsatz und das Management von KI im gesamten Unternehmen.

Sie adressiert entscheidende Fragen: Wer trägt das Risiko, wenn ein Modell unterperformt oder ausfällt? Wer trägt die letztendliche Verantwortung für dessen tägliche operative Wirksamkeit? Welcher formalisierte Prozess gilt zur Genehmigung neuer KI‑Projekte, um deren Ausrichtung an den Kernzielen des Unternehmens sicherzustellen? Ohne klare Antworten droht KI‑Entwicklung in organisatorisches Chaos zu kippen, was zu Ressourcenverschwendung und unmanaged Risiken führt.

Risikomanagement: Das Frühwarnsystem

Wenn Governance das Playbook ist, dann ist Risikomanagement der prädiktive Frühwarnmechanismus des Systems. Seine Aufgabe ist es, potenzielle Bedrohungen durch den Einsatz von KI systematisch zu identifizieren, zu analysieren und zu mindern. Dies geht über technische Störungen hinaus und umfasst ein breites Spektrum geschäftskritischer Gefahren.

Zentrale Fokusbereiche des KI‑Risikomanagements sind:

AI-Expertise gesucht?

Kontaktieren Sie uns, um zu erfahren, wie AI Ihr Unternehmen transformieren kann.

- Algorithmische Verzerrung: Sicherstellen, dass Modelle keine diskriminierenden Ergebnisse auf Basis geschützter Merkmale wie Geschlecht oder Ethnie liefern.

- Datenschutzverletzungen: Schutz der großen Datensätze, die für das Training von KI verwendet werden, vor der Offenlegung sensibler Kunden- oder Geschäftsgeheimnisse.

- Betriebliche Störungen: Management des materiellen Risikos eines KI‑Systemausfalls, der zentrale Geschäftsprozesse lahmlegen könnte.

- Reputationsschäden: Vermeidung von Szenarien, in denen die Ausgabe einer KI dem Unternehmensimage und dem öffentlichen Vertrauen erheblichen Schaden zufügt.

Ein effektiver Risikomanagementprozess zielt nicht auf Risikovermeidung — das ist unmöglich. Er zielt darauf ab, potenzielle Bedrohungen präzise zu verstehen, fundierte Entscheidungen über akzeptable Risikotoleranzen zu treffen und robuste Minderungspläne zu pflegen. Der Ansatz muss proaktiv, nicht reaktiv sein.

Compliance: Das Regelwerk

Schließlich repräsentiert Compliance die nicht verhandelbare Regelmenge. Diese Funktion stellt sicher, dass jede KI‑Aktivität strikt den externen Gesetzen, Vorschriften und internen Unternehmensrichtlinien entspricht. Für deutsche Unternehmen bedeutet das, sich in einem komplexen Umfeld zu bewegen, das DSGVO, das kommende EU‑KI‑Gesetz und etwaige branchenspezifische Standards umfasst.

Compliance liefert die prüfbaren Nachweise dafür, dass KI‑Systeme innerhalb rechtlicher und ethischer Grenzen betrieben werden. Sie übersetzt abstrakte gesetzliche Anforderungen in konkrete operative Maßnahmen, wie etwa die sorgfältige Dokumentation der Datenherkunft oder die Sicherstellung, dass Entscheidungen eines Modells gegenüber einer Aufsichtsbehörde erklärbar sind.

Für Organisationen, die den verantwortungsvollen Einsatz von KI ernst meinen, muss ein robustes GRC‑Rahmenwerk detaillierte Strategien zur Bewältigung dieser rechtlichen und ethischen Verpflichtungen beinhalten. Ein nützlicher Einstieg in diese Thematik findet sich in Ressourcen zum Meistern des regulatorischen Compliance‑Risk‑Managements. Wenn diese drei Säulen — Governance, Risk und Compliance — so gestaltet sind, dass sie im Einklang arbeiten, entsteht ein kraftvolles System, das schnelle Innovation ermöglicht, ohne Stabilität oder Integrität zu gefährden.

Das GRC‑Rahmenwerk ist nicht nur theoretisch; es lässt sich direkt in praktische Maßnahmen und kritische Fragestellungen für Ihre KI‑Teams übersetzen.

Bereit für Ihr AI-Projekt?

Lassen Sie uns besprechen, wie wir Ihnen helfen können, Ihr AI-Projekt in Wochen statt Monaten zu realisieren.

Das GRC‑Rahmenwerk angewandt auf KI‑Initiativen

| GRC‑Säule | Kernfunktion | Schlüsselfragen für KI‑Projekte | Beispielanwendung |

|---|---|---|---|

| Governance | Setzt Strategie, Rollen und Entscheidungsstrukturen. | Wer ist Eigentümer dieses KI‑Modells? Wer ist für dessen Leistung und ethische Implikationen verantwortlich? Wie genehmigen wir neue KI‑Use‑Cases? | Einrichtung eines KI‑Steuerungsausschusses mit Vertretern aus Recht, IT und den Fachbereichen, der alle KI‑Projekte vor Entwicklungsbeginn prüft und genehmigt. |

| Risikomanagement | Identifiziert, bewertet und mindert potenzielle Schäden. | Was kann bei diesem Modell schiefgehen (Bias, Datenschutz, Sicherheit)? Welche geschäftlichen Auswirkungen hätte ein Ausfall? Welche Minderungspläne haben wir? | Durchführung einer formellen „AI Impact Assessment“ vor dem Rollout eines kundenorientierten Chatbots, um potenzielle Verzerrungen in den Trainingsdaten zu identifizieren und einen Human‑in‑the‑Loop‑Review‑Prozess zu implementieren. |

| Compliance | Sichert die Einhaltung von Gesetzen, Vorschriften und internen Richtlinien. | Erfüllt dieses KI‑System DSGVO und das EU‑KI‑Gesetz? Können wir dies einem Auditor nachweisen? Wie dokumentieren wir Datenherkunft und Modellentscheidungen? | Einführung eines Modellregisters, das automatisch jede Modellversion, die Trainingsdaten und die Performance‑Metriken protokolliert, um Prüfungsanforderungen zu erfüllen. |

Indem diese Fragen systematisch für jede Säule adressiert werden, wird das abstrakte Konzept von GRC zu einem greifbaren Instrument für den Aufbau sichererer und effektiverer KI‑Systeme.

Navigation im deutschen regulatorischen Umfeld

Für jedes deutsche Unternehmen, das KI implementieren möchte, wird der Weg von einigen der strengsten regulatorischen Standards der Welt bestimmt. Das sollte nicht als Hindernis, sondern als strategischer Vorteil für Organisationen verstanden werden, die diesen Weg korrekt beschreiten. Ein methodischer Ansatz, verankert in Deutschlands spezifischen rechtlichen und Corporate‑Governance‑Prinzipien, stellt sicher, dass KI‑Initiativen nicht nur leistungsstark, sondern auch verteidigungsfähig und nachhaltig sind.

Zwischen 2020 und 2024 hat sich Deutschland als eine der ambitioniertesten — und zugleich streng regulierten — digitalen Umgebungen Europas etabliert. Der überarbeitete deutsche Prüfungsstandard IDW PS 340 n.F., gültig seit Januar 2021, schreibt vor, dass jedes prüfungspflichtige Unternehmen ein „frühes Risikenerkennungssystem" betreiben muss. Das verlangt mehr als reine Risikodokumentation; es erfordert ein System, das existenzielle Bedrohungen identifizieren und aggregieren kann, sodass dies durch einen Abschlussprüfer verifizierbar ist. Dies hat große Mittelstandsunternehmen und börsennotierte Konzerne dazu veranlasst, ihre Risikoinventare und Eskalationsprotokolle zu formalisieren.

Für das C‑Level ist die Schlussfolgerung klar: Jede signifikante neue Technologie, insbesondere eine so potente wie KI, muss innerhalb eines Rahmens eingesetzt werden, der intensiver regulatorischer Prüfung standhält.

Die Verpflichtung zu prüfbaren KI‑Risikosystemen

Der Standard IDW PS 340 hat tiefgreifende Implikationen für Künstliche Intelligenz. KI bringt eine neue Klasse von Risiken mit sich — von algorithmischer Verzerrung und Datenschutzverletzungen bis zu Modelldrift —, die traditionelle Risikoregister nicht konzipiert waren zu managen. Eine generische Risikomanagement‑Checkliste genügt nicht mehr.

Ihre Organisation benötigt ein System, das:

- KI‑spezifische Risiken proaktiv identifiziert: Dazu gehört die aktive Überwachung von Faktoren wie nachlassender Modellperformance, anomalen Ausgaben und den speziellen Sicherheitslücken von Machine‑Learning‑Systemen.

- Risiken quantifiziert und aggregiert: Das System muss komplexe technische Risiken in klare geschäftliche Auswirkungen übersetzen können, die in ein unternehmensweites Risikoprofil einfließen.

- Eine prüfbare Spur liefert: Jede Entscheidung — von der Modellwahl bis zu Monitoring‑Protokollen im Produktivbetrieb — muss dokumentiert und für Prüfer vollständig nachvollziehbar sein.

Hier werden die miteinander verknüpften Funktionen von Governance, Risk und Compliance kritisch wichtig.

Das obige Diagramm veranschaulicht diese Dynamik wirkungsvoll. Erfolgreiche KI‑Implementierung hängt nicht nur von der Technologie selbst ab, sondern vom kontinuierlichen Zusammenspiel zwischen der strategischen Richtung der Governance, der schützenden Aufsicht des Risikomanagements und den regelbasierten Leitplanken der Compliance.

Verantwortung auf Vorstandsebene unter dem GCGC

Um diesen Punkt zu verdeutlichen: Der German Corporate Governance Codex (GCGC) wurde 2022 aktualisiert und erweitert die exekutive Verantwortungsebene. Er verlangt nun explizit, dass ein formales Compliance‑Managementsystem (CMS) ein Kernbestandteil des internen Kontroll‑ und Risikorahmens eines Unternehmens ist.

Für den Vorstand bedeutet das: KI ist nicht länger nur ein IT‑Projekt; sie ist ein Governance‑Thema. Der Vorstand wird nun direkt erwartet, eine konforme Struktur zur Steuerung der mit solchen Technologien verbundenen Risiken sicherzustellen.

Diese Änderung hebt Risiko, Compliance und Governance von einer operativen Funktion auf eine Vorstandspflicht. Sie verlangt, dass KI‑Projekte von ihrer Entstehung an mit prüfbaren Kontrollen, transparenten Reporting‑Mechanismen und eindeutig definierten Verantwortlichkeiten gestaltet werden. Ein Versäumnis ist nicht bloß ein Projektmanagement‑Fehler, sondern kann eine Verletzung der Corporate‑Governance‑Pflichten darstellen. Detailliertere Ausführungen finden Sie in unserem Leitfaden zu KI im Risikomanagement und Compliance für deutsche Unternehmen.

Letzten Endes sind diese deutschen Regelwerke nicht darauf ausgerichtet, Innovation zu ersticken. Sie liefern eine Blaupause für den Aufbau vertrauenswürdiger, resilienter und wirklich unternehmensfähiger KI. Indem Führungskräfte diese Standards annehmen, können sie ihre KI‑Investitionen entschärfen und einen dauerhaften Wettbewerbsvorteil etablieren, der auf operativer Exzellenz und unerschütterlicher regulatorischer Integrität fußt.

Aufbau der richtigen KI‑Governance‑Struktur

Effektive KI‑Governance ist nicht primär eine technologische Herausforderung; sie ist eine organisatorische, gebaut auf Menschen und Prozessen. Für deutsche Unternehmen liegt der Unterschied zwischen isolierten KI‑Experimenten und einem wirklich wertschöpfenden, skalierbaren Asset im Aufbau einer kohärenten Struktur für Risiko, Compliance und Governance.

Innovation beschleunigen?

Unser Expertenteam hilft Ihnen, Ideen in produktionsreife Lösungen zu verwandeln.

Das Ziel ist nicht, Bürokratie zu schaffen, sondern klare Verantwortungswege und logische Prozesse zu etablieren, die Innovation beschleunigen, indem sie Unklarheiten beseitigen. So wird Governance zum Ermöglicher und gibt Teams die nötigen Leitplanken, um mit Geschwindigkeit und Zuversicht zu arbeiten.

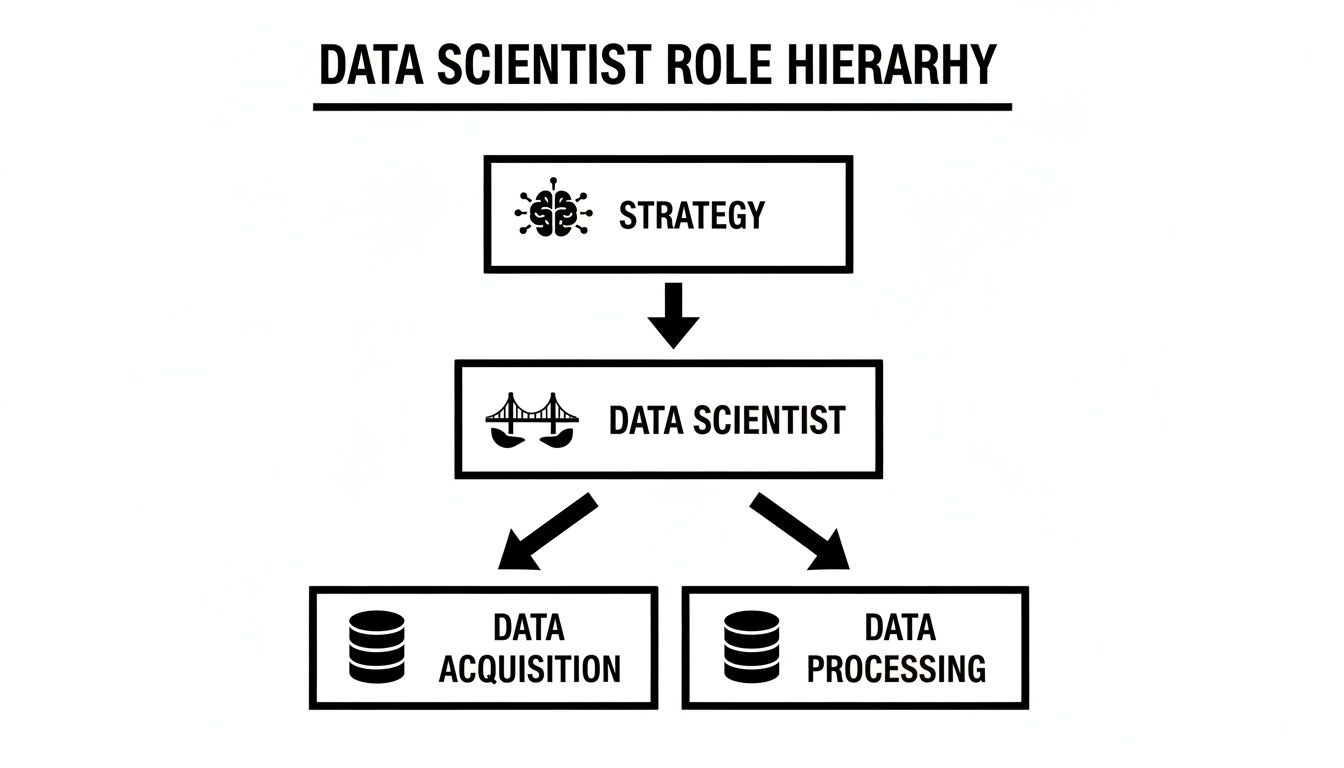

Definition essenzieller Rollen und Verantwortlichkeiten

Ein Hauptgrund für das Scheitern von KI‑Projekten ist unklare Ownership. Wenn Verantwortung diffus ist, gehen wichtige Details verloren und Aufsicht wird zur formalen Übung. Eine leistungsfähige Governance‑Struktur besetzt die richtigen Personen mit klar definierten Rollen und schließt die Lücke zwischen technischer Expertise und strategischen Business‑Zielen.

Mehrere Schlüsselrollen sind unverzichtbar:

- AI Product Owner: Diese Person fungiert als Business‑Champion für eine KI‑Initiative. Sie ist verantwortlich für deren Return on Investment (ROI), stellt die Ausrichtung an Unternehmenszielen sicher und ist letztlich rechenschaftspflichtig für den Betrieb innerhalb der definierten Risikobereitschaft der Organisation.

- MLOps Lead: Der technische Gegenpart zum Product Owner; diese Rolle überwacht den gesamten Machine‑Learning‑Lebenszyklus — von Entwicklung und Deployment bis zur laufenden Wartung — und gewährleistet Systemzuverlässigkeit, Sicherheit und Performance.

- AI Ethics Board (oder -Rat): Dies ist das strategische Lenkungsgremium. Es sollte ein funktionsübergreifendes Gremium aus Führungskräften aus Recht, Personal, Data Science und den zentralen Fachbereichen sein. Es legt hochrangige Richtlinien für verantwortungsvolle KI fest und entscheidet über komplexe ethische Fragestellungen.

Die wirksamsten Governance‑Strukturen beruhen auf einer Grundlage geteilter Verantwortung. Obwohl spezifische Rollen unterschiedliche Rechenschaftspflichten tragen, ist die Integrität eines KI‑Systems eine kollektive Aufgabe — vom Data Scientist, der das Modell entwickelt, bis zur Führungskraft, die die Fachabteilung leitet, der das System dient.

Wahl des passenden Governance‑Modells

Ein universell passendes Governance‑Modell gibt es nicht. Die optimale Struktur hängt von Unternehmensgröße, Unternehmenskultur und KI‑Reifegrad ab. Unsere Beobachtungen zeigen, dass deutsche Organisationen in der Regel eines von zwei Hauptmodellen anwenden, die jeweils unterschiedliche Vor‑ und Nachteile im Management von Risiko und Compliance aufweisen.

AI-Expertise gesucht?

Kontaktieren Sie uns, um zu erfahren, wie AI Ihr Unternehmen transformieren kann.

Die Gestaltung der richtigen Struktur ist mehr als ein Organigramm‑Projekt. Für eine vertiefte Analyse praktischer Umsetzungsempfehlungen empfehlen wir diese 10 Best Practices zur KI‑Governance.

Zentralisiertes vs. föderiertes Governance

Ein zentralisiertes Modell bündelt alle Governance‑Befugnisse in einer einzigen Stelle, typischerweise einem Centre of Excellence (CoE). Dieser Ansatz sorgt für maximale Konsistenz und Kontrolle und eignet sich besonders für Unternehmen in stark regulierten Branchen oder für Organisationen in frühen Phasen der KI‑Adoption, da er Audits vereinfacht und eine einheitliche Einhaltung von Standards garantiert.

Demgegenüber verteilt ein föderiertes Modell die Governance‑Verantwortung. Ein zentrales Team legt übergeordnete Richtlinien und Standards fest, einzelne Fachbereiche oder Produktteams sind jedoch befugt, ihre KI‑Projekte innerhalb dieser Vorgaben selbstständig zu steuern. Das fördert höhere Agilität und beschleunigt Innovation, weshalb es besser zu größeren, dezentrale Organisationen mit etablierten KI‑Fähigkeiten passt. Die organisatorischen Gestaltungsprinzipien dieses Modells spiegeln Dynamiken wider, die im McKinsey 7‑S Modell untersucht werden.

Die Wahl ist ein strategischer Trade‑off.

Vergleich der KI‑Governance‑Modelle

Bereit für Ihr AI-Projekt?

Lassen Sie uns besprechen, wie wir Ihnen helfen können, Ihr AI-Projekt in Wochen statt Monaten zu realisieren.

| Merkmal | Zentralisiertes Modell | Föderiertes Modell |

|---|---|---|

| Entscheidungsbefugnis | Liegt bei einem einzigen, zentralen Ausschuss oder CoE. | Wird an Fachbereiche innerhalb zentraler Richtlinien delegiert. |

| Am besten geeignet für | Organisationen, die mit KI starten; Hochrisiko‑Umgebungen. | Reife, dezentralisierte Organisationen mit mehreren KI‑Teams. |

| Hauptvorteil | Hohe Konsistenz, starke Kontrolle, vereinfachte Compliance. | Größere Agilität, schnellere Innovation, Autonomie der Fachbereiche. |

| Potenzielle Herausforderung | Kann zum Engpass werden und Innovation verlangsamen. | Risiko inkonsistenter Anwendung von Standards, wenn nicht gut gesteuert. |

Die optimale Struktur ist diejenige, die mit Ihrer Unternehmenskultur und Ihren strategischen Zielen übereinstimmt. Sie muss robuste Aufsicht bieten, ohne die Innovation zu ersticken, die sie schützen soll. Das Erreichen dieses Gleichgewichts verwandelt KI‑Governance von einer administrativen Bürde in einen bedeutenden Wettbewerbsvorteil.

Eine umsetzbare Roadmap zur Implementierung von AI GRC

Die Umsetzung ist der Punkt, an dem Strategie Realität wird. Für deutsche Unternehmen ist die effektivste Methode zur Implementierung von KI‑Risiko, Compliance und Governance nicht ein groß angelegtes, mehrjähriges Programm, sondern ein phasenweiser, iterativer Ansatz.

Diese Methodik liefert schnell greifbare Ergebnisse, vermeidet langwierige Verzögerungen und ermöglicht es dem Rahmenwerk, parallel zu den KI‑Fähigkeiten der Organisation zu reifen. Der Fokus liegt darauf, nachweisbare Fortschritte zu erzielen und robuste Aufsicht zu etablieren, ohne das Innovations tempo zu hemmen.

Phase 1: Grundlagen und Bestandsaufnahme

Der erste Schritt besteht darin, eine klare Ausgangsbasis zu schaffen. Bevor Sie KI steuern, ist es wichtig, ihre aktuelle und geplante Präsenz im Unternehmen zu verstehen. Diese Phase ist eine Übung in strategischer Transparenz.

Beginnen Sie mit der Erstellung eines Inventars aller KI‑Anwendungsfälle, sowohl aktiver als auch in Entwicklung befindlicher. Behandeln Sie dies als strategische Kartierung und nicht als erschöpfende technische Prüfung. Dokumentieren Sie für jeden Use Case dessen geschäftliches Ziel, die genutzten Daten und den benannten Eigentümer.

Innovation beschleunigen?

Unser Expertenteam hilft Ihnen, Ideen in produktionsreife Lösungen zu verwandeln.

Mit dieser Karte führen Sie eine grobe Risikoanalyse durch. Priorisieren Sie jedes Projekt anhand seines potenziellen Impacts: Sensitivität der Daten, operative Kritikalität und mögliche regulatorische Exponierung. Diese Priorisierung ermöglicht es, Governance‑Ressourcen zunächst auf die risikoreichsten Bereiche zu konzentrieren.

Phase 2: Rahmenwerks‑Design

In der nächsten Phase wird die Governance‑Architektur konstruiert. Hier werden hochrangige Prinzipien in konkrete, operative Richtlinien und Prozesse übersetzt. Das Ziel ist kein generisches Regelwerk, sondern ein Rahmen, der auf Kultur und regulatorisches Umfeld Ihres Unternehmens zugeschnitten ist.

Wesentliche Ergebnisse dieser Phase sind:

- Definition KI‑spezifischer Richtlinien: Entwicklung klarer, prägnanter Leitlinien für KI‑Entwicklung, Datenverarbeitung, Modellvalidierung und ethische Nutzung. Diese sollten bestehende Unternehmensrichtlinien ergänzen, nicht ersetzen.

- Einrichtung des Governance‑Gremiums: Formelle Konstituierung des funktionsübergreifenden AI Ethics Board oder Steering Committee. Vergeben Sie ein klares Mandat, echte Entscheidungsbefugnis und einen regelmäßigen Sitzungsrhythmus.

- Auswahl zentraler Kontrollen: Identifizierung eines Kernsets nicht verhandelbarer Kontrollen, wie verpflichtende Bias‑Tests für KI‑Systeme im Recruiting oder strikte Zugriffskontrollen für sensible Trainingsdaten.

Dies ist der kritische Schritt, in dem das Konzept „verantwortungsvolle KI" vom Slogan zur operativen Realität wird.

Phase 3: Pilot und Integration

Mit dem entworfenen Rahmenwerk ist es Zeit für die praktische Validierung. Die effektivste Methode, die Durchführbarkeit Ihres Governance‑Plans zu testen, ist die Anwendung auf ein Live‑Projekt. Ein Pilot bietet die Gelegenheit, Lücken zu identifizieren, Wert nachzuweisen und organisatorische Unterstützung für einen Rollout im gesamten Unternehmen aufzubauen.

AI-Expertise gesucht?

Kontaktieren Sie uns, um zu erfahren, wie AI Ihr Unternehmen transformieren kann.

Wählen Sie ein einzelnes, hochwirksames KI‑Projekt — idealerweise eines, das in Phase 1 als moderat bis hoch riskant eingestuft wurde — als Pilot. Wenden Sie die neuen Richtlinien, Kontrollen und Governance‑Aufsicht während des gesamten Lebenszyklus an. Das direkte Feedback ist von unschätzbarem Wert.

Dies ist auch der Zeitpunkt für die technische Integration. Der deutsche Markt für GRC‑Technologie wächst rasant, getrieben von intensivem regulatorischem Druck. Als Europas größter Markt für GRC‑Plattformen, mit einem Wert von rund USD 14,8 Milliarden im Jahr 2024 und einer prognostizierten jährlichen Wachstumsrate von 12,4%, ist klar, dass jedes erfolgreiche KI‑Programm in den primären unternehmensweiten GRC‑Stack integriert werden muss, um prüfbare Spuren und Kontrollen sicherzustellen. Weitere Einsichten finden Sie in der Analyse des europäischen GRC‑Plattformmarkts auf imarcgroup.com.

Der Pilot ist nicht nur ein Test; er ist ein Beweisstück. Ein erfolgreiches Ergebnis schafft die Business‑Case‑ und interne Glaubwürdigkeit, die für eine unternehmensweite Implementierung erforderlich sind. Es zeigt, dass Governance kein Hindernis, sondern eine Leitplanke für sichere Innovation ist.

Phase 4: Skalierung und kontinuierliche Verbesserung

Nach einem erfolgreichen Pilot sind Sie bereit, das Rahmenwerk organisationsweit zu skalieren. Die gewonnenen Erkenntnisse werden den Rollout vereinfachen und Risiko, Compliance und Governance in die operative DNA des Unternehmens einbetten.

Die Aufgabe besteht nun darin, das GRC‑Rahmenwerk systematisch auf alle KI‑Initiativen anzuwenden — bestehende wie neue. Automatisieren Sie Monitoring‑ und Reporting‑Funktionen, wo immer möglich. Nutzen Sie Dashboards, um der Führungsebene eine Echtzeit‑Sicht auf die KI‑Risikolandschaft zu geben. Für eine detailliertere Betrachtung dieses Prozesses verweisen wir auf unseren Leitfaden zur Strukturierung von Risiko‑ und Compliance‑Management.

Bereit für Ihr AI-Projekt?

Lassen Sie uns besprechen, wie wir Ihnen helfen können, Ihr AI-Projekt in Wochen statt Monaten zu realisieren.

Entscheidend ist: Das Rahmenwerk darf nicht statisch sein. Die Domänen der KI und ihrer Regulierung sind einem ständigen Wandel unterworfen. Ein statisches Governance‑Modell wird schnell obsolet. Etablieren Sie einen regelmäßigen Überprüfungszyklus, um sicherzustellen, dass Ihr Rahmenwerk scharf, relevant und zukunftssicher bleibt.

Compliance als Wettbewerbsvorteil nutzen

Es ist ein häufiger, aber schwerwiegender strategischer Fehler, Risiko, Compliance und Governance ausschließlich als Kostenstelle zu betrachten. Für deutsche Unternehmen ist eine ausgereifte GRC‑Strategie nicht nur eine defensive Maßnahme; sie ist ein Katalysator für nachhaltiges Wachstum und ein differenzierender Vorteil auf dem globalen Wettbewerb.

Die Erzählung muss sich von regulatorischer Last zu geschäftlichem Wert verschieben. Wenn KI‑Systeme von Beginn an mit eingebetteter Compliance entwickelt werden, erfüllen sie nicht nur Prüfungsanforderungen. Sie steigern die operative Effizienz, schaffen unerschütterliches Vertrauen bei Kunden und Partnern und eröffnen Chancen in neuen Märkten.

Von regulatorischer Last zu strategischem Asset

Betrachten Sie die erhebliche administrative Belastung durch neue Regelungen wie die Corporate Sustainability Reporting Directive (CSRD). Der manuelle Aufwand für Datensammlung, Verifizierung und Reporting ist immens. In diesem Kontext zeigt eine Compliance‑zuerst‑KI‑Strategie sofortigen Wert.

Innovation beschleunigen?

Unser Expertenteam hilft Ihnen, Ideen in produktionsreife Lösungen zu verwandeln.

Das eröffnet signifikante Chancen für KI‑gestützte Innovationen in Deutschland. KI‑Systeme können Datenaggregation automatisieren, Nachweisaufzeichnungen verwalten und Szenarioanalysen für CSRD, CSDDD und andere Risikoaudits durchführen. Solche Tools „unterstützen" nicht nur die Compliance — sie reduzieren aktiv den wiederkehrenden regulatorischen Aufwand, der nach Regierungsangaben Millionen Euro pro Regulierung kosten kann. Für weiteren Kontext verweisen wir auf den OECD Regulatory Policy Outlook für Deutschland.

Vertrauen durch transparente KI aufbauen

Auf einem Markt, der auf Qualität und Zuverlässigkeit beruht, ist Vertrauen die letztliche Währung. Ein robustes AI‑GRC‑Rahmenwerk liefert den prüfbaren Beleg, dass Ihre Systeme fair, sicher und unverzerrt sind. Dieses Maß an Transparenz ist nicht länger eine optionale Funktion; es ist eine fundamentale Erwartung von Kunden, Partnern und Regulatoren.

Durch verantwortungsvolle Pflege von Daten und Algorithmen können deutsche Unternehmen eine Marktprämie erzielen, Top‑Talente anziehen und stärkere Beziehungen zu Unternehmens‑Kunden aufbauen, die Integrität priorisieren. So werden regulatorische Anforderungen in einen strategischen Vorteil verwandelt.

Diese proaktive Governance‑Haltung stärkt außerdem die Cybersicherheit. Eine strukturierte Methodik zum Management von KI‑Risiken ist eng mit Cyber‑Resilienz verknüpft. Unsere Erkenntnisse zum Aufbau eines robusten Schutzes, wie in unserer Arbeit zur Cyber‑Security‑Beratung dargelegt, können in diesem Bereich wertvolle Orientierung bieten.

Letztlich werden jene Unternehmen den Markt anführen, die Risiko, Compliance und Governance für ihre KI‑Initiativen meistern. Sie werden schneller und sicherer innovieren und wahrgenommene Hindernisse in das Fundament ihres Wettbewerbsvorteils verwandeln. Es ist ein methodischer, entschärfter Ansatz, der nicht nur aktuelle Projekte, sondern langfristigen Unternehmenswert sichert.

Häufig gestellte Fragen zu AI GRC

Die Implementierung eines formalen Programms für Risiko, Compliance und Governance im Bereich KI wirft unweigerlich schwierige Fragen auf. Diese direkt anzusprechen ist der einzige Weg, um technische Teams und Geschäftsführung auf das gemeinsame Ziel verantwortungsvoller Innovation auszurichten.

Hier sind einige der häufigsten Fragen, die uns aus deutschen Unternehmen begegnen, zusammen mit unseren direkten Antworten.

Wir haben KI‑Projekte im Betrieb, aber kein formales GRC. Wo sollen wir beginnen?

Führen Sie zuerst eine schnelle Bestandsaufnahme aller KI‑Projekte durch, um die risikoreichsten Bereiche zu identifizieren. Das muss kein erschöpfender Audit sein. Stellen Sie ein kleines, funktionsübergreifendes Team aus Recht, IT und relevanten Fachbereichen zusammen, um einen klaren Überblick über die KI‑Aktivitäten zu erstellen.

Priorisieren Sie Projekte anhand ihres Risiko‑Profils, unter Berücksichtigung der verwendeten Daten, ihrer geschäftlichen Kritikalität und geltender Vorschriften. Wählen Sie das eine höchstrisiko Projekt als Pilot aus. Nutzen Sie dieses Projekt, um einen „minimum viable" GRC‑Prozess zu etablieren: Dokumentation des Zwecks, der Datenquellen und der Entscheidungslogik. Dieser Ansatz erzeugt Momentum und zeigt sofortigen Wert, ohne den Betrieb zu stoppen.

Wie können wir KI steuern, ohne die Agilität unserer Teams zu behindern?

Das Ziel ist, Leitplanken zu implementieren, keine Hindernisse. Das Rahmenwerk sollte Ihre Teams befähigen, nicht einschränken. Ein föderiertes Governance‑Modell ist hier besonders wirksam: Ein zentrales Gremium setzt Standards und stellt Expertise bereit, während die Innovationsteams innerhalb dieser definierten Grenzen autonom arbeiten.

AI-Expertise gesucht?

Kontaktieren Sie uns, um zu erfahren, wie AI Ihr Unternehmen transformieren kann.

Der Zweck von KI‑Governance ist, Innovation sicher und in hoher Geschwindigkeit zu ermöglichen. Wenn Kontrollen direkt in den Entwicklungsworkflow integriert werden, wird Compliance nicht mehr zur bürokratischen Hürde, sondern zur gemeinsamen Verantwortung. Dieser Ansatz beschleunigt die Lieferung, indem er Probleme frühzeitig identifiziert, nicht erst am Ende.

Behandeln Sie GRC nicht als Endabnahme. Integrieren Sie Checkpoints in Ihre agilen Sprints. Stellen Sie Teams automatisierte Tools für Sicherheits‑Scans oder Bias‑Erkennung zur Verfügung. Wenn Compliance ein intrinsischer Bestandteil des Prozesses ist, erreichen Sie sowohl Geschwindigkeit als auch Strenge.

Was sind die wichtigsten KPIs für unser AI‑GRC‑Programm?

Wirksame KPIs sollten ein ganzheitliches Bild liefern. Ein ausgewogener Satz an Metriken, der Risiko, Betrieb und Geschäftswert abdeckt, ist essenziell. Vermeiden Sie Vanity‑Metriken ohne substanziellen Aussagewert.

Erwägen Sie einen Balanced‑Scorecard‑Ansatz für Ihr Programm:

- Risikomanagement: Verfolgen Sie die Anzahl der KI‑bezogenen Risiken, die vor der Einführung identifiziert und gemindert wurden. Diese Kennzahl zeigt eine proaktive Haltung.

- Compliance: Messen Sie den Prozentsatz der Hochrisiko‑Modelle mit vollständiger, prüfungsbereiter Dokumentation. Das belegt die Bereitschaft für regulatorische Prüfungen.

- Betriebliche Gesundheit: Überwachen Sie die Rate von Modell‑Performance‑Drift über die Zeit. Das zeigt die laufende Zuverlässigkeit Ihrer KI‑Systeme an.

Wesentlich ist, dass Sie GRC‑Aktivitäten mit Geschäftsergebnissen verknüpfen. Verfolgen Sie Kennzahlen wie „Kostenersparnis durch automatisierte Compliance‑Aufgaben" oder „Umsatz generiert durch KI‑Systeme innerhalb der definierten Risikobereitschaft." Das macht eindeutig deutlich, dass Ihr Risiko, Compliance und Governance-Programm nicht nur eine Kostenstelle ist, sondern ein zentraler Beitrag zu einem resilienten und wachsenden Unternehmen.

Bereit für Ihr AI-Projekt?

Lassen Sie uns besprechen, wie wir Ihnen helfen können, Ihr AI-Projekt in Wochen statt Monaten zu realisieren.

Bei Reruption GmbH agieren wir als Co‑Preneurs und begleiten Sie bei der Implementierung von KI‑Strategien, die nicht nur innovativ, sondern von Tag eins an sicher und compliant sind. Wir helfen dabei, Ihre ambitionierten Ideen mit P&L‑Verantwortung in produktionsreife Innovationen zu überführen. https://www.reruption.com